인공지능을 개발하자는 쪽과 지금이라도 인공지능 개발 속도를 신중하게 고려하자는 쪽이 팽팽하게 대립하고 있다. 이번 호에는 인공지능을 둘러싼 찬반 양쪽의 쟁점을 다룬 두 번의 인공지능 윤리 초등수업의 사례를 재구성하여 소개하고자 한다.

사례1 - 자동차 발명을 둘러싼 논쟁과 쟁점들

1860년 벨기에 태생의 프랑스 발명가 에티엔 르누아르가 휘발유를 연료로 하는 내연기관을 발명했다. 그리고 곧 휘발유를 연료로 하는 자동차가 길에 등장했다. 사람들은 말보다 조금 더 빠른(때로는 더 느린) 속력으로 달리는 시끄러운 기계 덩어리(자동차)를 보고 다음과 같이 생각했었다고 한다.

• 이것은 대체 무슨 쓸모가 있는 것일까?

• 마차가 훨씬 조용하고 빠르며 비용도 적게 드는 데다 매캐한 연기를 맡지 않아도 되는걸!

• 이것이 나옴으로써 마부들이 일자리를 잃고 사람들이 다치지 않을까?

그러나 사람들의 우려에도 불구하고 자동차는 금세 말의 속도보다 빨라졌으며, 1913년 미국의 기업인이자 기술자인 헨리 포드의 컨베이어벨트 시스템으로 자동화를 이룩해 생산 비용을 획기적으로 낮출 수 있었다. 하지만 여전히 마부들의 일자리와 사람들이 치어 다치거나 죽는 문제는 해결되지 않았다. 물론 조용해지지도 않았다. 그래서 그들은 자동차를 개발하지 않기로 합의했을까? 19세기 사람들은 자동차를 계속 개발하기로 했다. 그 결과 지금까지 자동차는 성능과 비용 면에서 계속 발전을 거듭하고 있다.

만약, 1860년 이후에 마부들의 일자리를 지키기 위해서 자동차를 개발하지 않았다면 어떤 일이 일어났을까? 또 자동차가 사람들을 치어 다치게 한다는 사실 때문에 자동차 생산을 중단했다면? 우리는 이런 상황을 쉽게 상상할 수 없다. 그러면 우리 조상들은 비용과 성능과 같은 문제뿐 아니라 마부의 일자리와 자동차 사고 같은 문제를 어떻게 해결했을까? 달리는 자동차가 운전자와 보행자를 보호하기 위해 가장 먼저 필요한 것을 떠올려보자.

여기서 잠깐!

수업에서는 현재 인공지능 윤리로 거론되는 문제들을 과거 유사한 사례에 비추어 아이들이 생각해볼 수 있도록 교사가 적절한 질문을 준비해야 한다.

학생: “자동차 부품이요!” “안전장치요!”

그렇다. 밟으면 바로 멈추는 브레이크, 안전하게 방향을 바꿀 수 있는 조향장치, 범퍼와 에어백, 보행자에게 경고할 수 있는 클랙슨, 부딪혔을 때 차체와 사람을 보호해줄 수 있는 범퍼와 같은 기계적인 안전장치를 먼저 떠올릴 수 있다.

학생: “신호등이요.” “교통경찰이요!”

그리고 신호등과 방향 표지판, 중앙선 또는 보행자와 차량이 나뉘어 다닐 수 있는 잘 정비된 도로와 같은 사회적 인프라가 필요하다. 운전자와 보행자 각각에 맞는 교통법규 또한 빼놓을 수 없다. 적정 속도와 스쿨존 등 변화되는 도로 상황을 반영하는 것도 잊지 말아야 한다. 또 운전자와 보행자 안전에 대한 시민들의 의식 교육도 필요하다. 가령 다음과 같은 상황을 살펴보자.

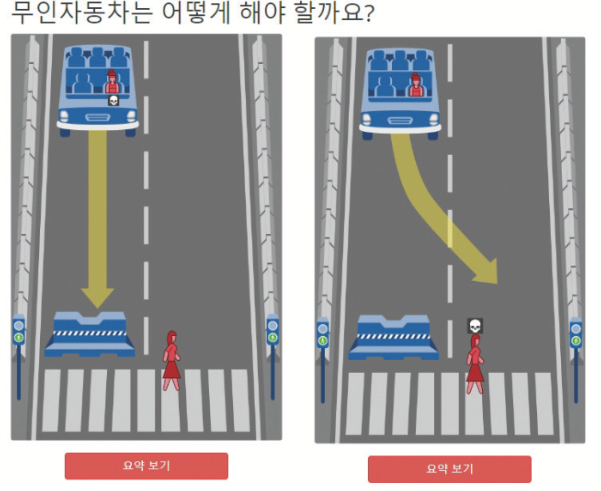

브레이크가 고장 난 무인자동차의 선택에 따라 운전자 또는 보행자가 다친다. 혹은 누구를 보호해야 할지(혹은 다치게 할지)에 대한 기준은 어떻게 정할 수 있을까? 잊지 말아야 할 것이 있다. 그것을 정할 권리는 현재를 살아가는 우리 자신에게 있다. 그렇기 때문에 우리는 더욱 인공지능에 대해서 잘 공부하고 인공지능 윤리를 정하기 위한 이야기에 참여해야 한다.

그럼 인공지능에 두려움을 느끼는 사람의 의견에 귀 기울여 보자. 그들의 주요 주장은 인공지능이 가져올 문제를 염두에 두고 개발을 중지하든가 속도를 늦추자는 것이다. 하지만, 자동차의 사례에서도 알 수 있듯 기술 발전은 비용은 줄이고 성능은 높였다. 인공지능도 그렇게 될 가능성이 있다.

학생: “마부 대신 더 많은 운전자가 필요해진 것처럼 인공지능이 대체한 일자리 대신 새로운 직업이 생겨나지 않을까요?”

인공지능의 부작용에 대한 두려움 때문에 개발을 중지하거나 속도를 늦추지 말고 안전하게 사용할 수 있는 방법을 함께 고민하면 어떨까? 오늘 수업의 주제가 인공지능 도덕, 법, 규칙이 아니라 윤리라고 부르는 까닭은 바로 이것이다.

내연기관 발명으로 인해 생겨난 문제를 논의해보는 학생들

내연기관 발명으로 인해 생겨난 문제를 논의해보는 학생들

출처: www.moralmachine.net/hl/kr

출처: www.moralmachine.net/hl/kr

사례2 - 우주 쓰레기 논쟁과 개인정보보호

이번에는 우주로 간 유인우주선을 생각해보자. 최초의 우주 쓰레기는 최초의 인공위성 스푸트니크 1호가 지구 궤도에 진입하면서 이 위성을 싣고 간 30m에 달하는 거대한 로켓이었다. 1957년 10월 4일, 이날이 인류가 우주에 처음 쓰레기를 버린 날이다. 이후 50년 동안 우주로 버려진 물체는 임무가 끝난 인공위성을 비롯해 우주비행사가 놓친 스패너, 크고 작은 부속을 비롯해 수도 없이 많다.

우주 쓰레기의 양은 매우 많고, 그걸 청소해서 생기는 경제적인 이득도 당장은 없지만, 미래에는 우주 쓰레기를 제거할 능력이 있거나 우주 쓰레기 되가져오기 사업에 동참한 나라들만이 우주 개발권을 주장하게 될지도 모른다. 인공지능을 개발하다 보면 반드시 필요 없는 어떤 것, 즉 우주에서 발생하는 쓰레기와 같은 문제가 생길 것이다. 그런 문제가 발생하면 우리는 어떻게 해야 할까?

그나마 가능한 대답은 예측할 수 있는 범위에서 안전장치를 마련하고, 여러 번의 테스트를 거치고, 그래도 문제가 발생하면 해결하는 것이다. 바로 우주 쓰레기를 되가져 오는 것처럼 말이다. 그리고 문제를 해결해야 할 상황이 오면 해결해 본 경험이 있는 사람이 가장 잘 해결한다는 것을 알게 될 것이다. 불확실성을 줄이기 위해서는 더 많이 경험하고 더 많은 데이터를 축적해야 한다.

데이터는 인공지능을 똑똑하게 만드는 가장 기본적인 힘이었다. 그래서 과거에는 그 데이터가 크게 의미가 없었다면 이제는 그 데이터가 인공지능을 통해서 자동화된 시스템을 만드는 회사에는 꼭 필요해졌다. 내가 선호하는 음악이나 가수를 쉽게 찾아주는 유튜브 추천 영상이나 서둘러 로그아웃한 사이트의 장바구니가 다음에 접속할 때까지 남아있는 이런 기술의 편리함은 그곳에서 시작된 것이다.

하지만 우리의 동의가 어디까지인지, 개인정보의 침해 범위를 어디까지 정할 것인지에 대해서는 기업과 개인, 국가가 생각하는 범위가 각각 다를 수도 있다. 개인도 사람에 따라 어디까지의 편리와 어느 정도의 자유를 중요시하는지 다를 수 있다. 그래서 우리는 인공지능 개발 속도와 함께 이 부분에 대한 사회적 접점을 찾기 위해 지금보다 적극적으로 노력해야 한다.

“우리의 모든 탐색의 끝은 우리가 시작했던 곳에 도달하는 것, 그리고 그곳을 처음으로 이해하는 것이다.”

- 시인 T.S.엘리엇 <리틀 기딩>에서

문제가 무엇인지를 정확하게 아는 것은 해결책을 찾기 위한 처음이자 마지막일지도 모른다. 인공지능을 둘러싼 이슈들에 대해 충분한 논의와 사회적 합의를 거친다면 우리는 더 이상 인공지능, 응용 통계1가 두렵지 않을 것이다.